Ollama und lokale Sprachmodelle können auch über das Netzwerk genutzt werden. Im nachfolgenen Beispiel wird Ollama auf einem Mac ausgeführt. Als Sprachmodell verwende ich gemma4. Dieses Modell soll von einem anderen Rechner, einem Linux-PC, verwendet werden. Vorausstzung ist, dass in den Einstellungen von Ollama der Zugriff über das Netzwerk gestattet wird. Diese Einstellung kann über

> Ollama > Settingsaufgerufen werden. Dort ist die Option Expose Ollama to the network zu aktivieren.

Wie in diesem Artikel erklärt kann nun curl dafür verwendet werden, eine Anfrage an das Sprachmodel zu übergeben. Zunächst möchte ich aber herausfinden, welche Sprachmodelle überhaupt zur Verfügung stehen. Der Befehl dafür sieht folgendermaßen aus:

curl -s http://192.168.171.24:11434/api/tags | jqMein Mac hat die IP-Adresse 192.168.171.24. Dies müsst ihr anpassen, also die IP-Adresse jenes Geräts verwenden, auf dem Ollama läuft.

Die Rückmeldung des curl-Befehls wird an jq weitergereicht. Dieses nützliche Tool zeigt die Informationen zu den zur Verfügung stehenden Modellen im JSON-Format an, was die Lesbarkeit deutlich erhöht.

{

"models": [

{

"name": "gemma4:e2b",

"model": "gemma4:e2b",

"modified_at": "2026-05-07T11:19:39.466589483+02:00",

"size": 7162405886,

"digest": "7fbdbf8f5e45a75bb122155ed546e765b4d9c53a1285f62fd9f506baa1c5a47e",

"details": {

"parent_model": "",

"format": "gguf",

"family": "gemma4",

"families": [

"gemma4"

],

"parameter_size": "5.1B",

"quantization_level": "Q4_K_M"

}

}

]

}Wie den Daten entnommen werden kann, steht auf dem Mac das Sprachmodell gemma4:e2b zur Verfügung. An dieses Modell soll nun mithilfe von curl eine Frage gesendet werden:

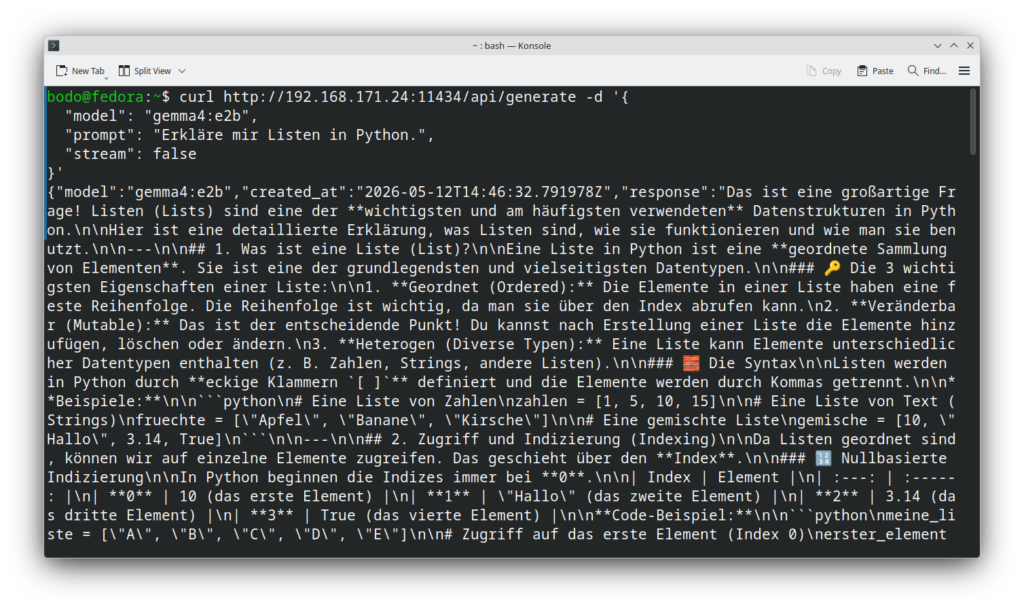

curl http://192.168.171.24:11434/api/generate -d '{

"model": "gemma4:e2b",

"prompt": "Erkläre mir Listen in Python.",

"stream": false

}'Dies führt bei mir im Terminal zu folgender Ausgabe:

Anstatt curl im Terminal zu verwenden, kann man auch ein Shell-Skript nutzen:

#!/bin/bash

# Benutzer zur Eingabe eines Textes auffordern

read -p "Bitte geben Sie den Text ein: " input_text

# Die URL der Ollama-Schnittstelle

url="http://192.168.171.24:11434/api/generate"

# Daten im JSON-Format der Variable json_data zuweisen

json_data=$(jq -n \

--arg prompt "$input_text" \

--arg model "gemma4:e2b" \

'{

prompt: $prompt,

model: $model,

stream: false,

options: {

temperature: 0.7

}

}')

# Die Anfrage an Ollama senden

response=$(curl -s -X POST "$url" -H "Content-Type: application/json" -d "$json_data")

# Nur das eigentliche Antwortfeld extrahieren

answer=$(echo "$response" | jq -r '.response')

# Zu Documents wechseln

cd ~/Documents

# Die Antwort in einer Markdown-Datei speichern

printf "# Antwort\n\n## Eingabe\n\n%s\n\n## Ausgabe\n\n%s\n" "$input_text" "$answer" > ollama_response.md

echo "Die Antwort wurde in 'ollama_response.md' gespeichert."Die Ausführung dieses Skripts, das bei mir den Namen ask_ollama.sh hat, führt dazu, dass man zur Eingabe einer Frage aufgefordert wird. Das Skript ruft dann curl auf und sendet diese Frage an Ollama. Die Antwort wird im Dokumente-Verzeichnis in der Datei ollama_response.md gespeichert.

Ihr müsst darauf achten, dass ihr im Skript die IP-Adresse eures Rechners und das richtige Sprachmodell verwendet. Außerdem muss das Skript ausführbar gemacht werden:

chmod u+x ask_ollama.shNun kann es im Terminal wie folgt ausgeführt werden:

./ask_ollama