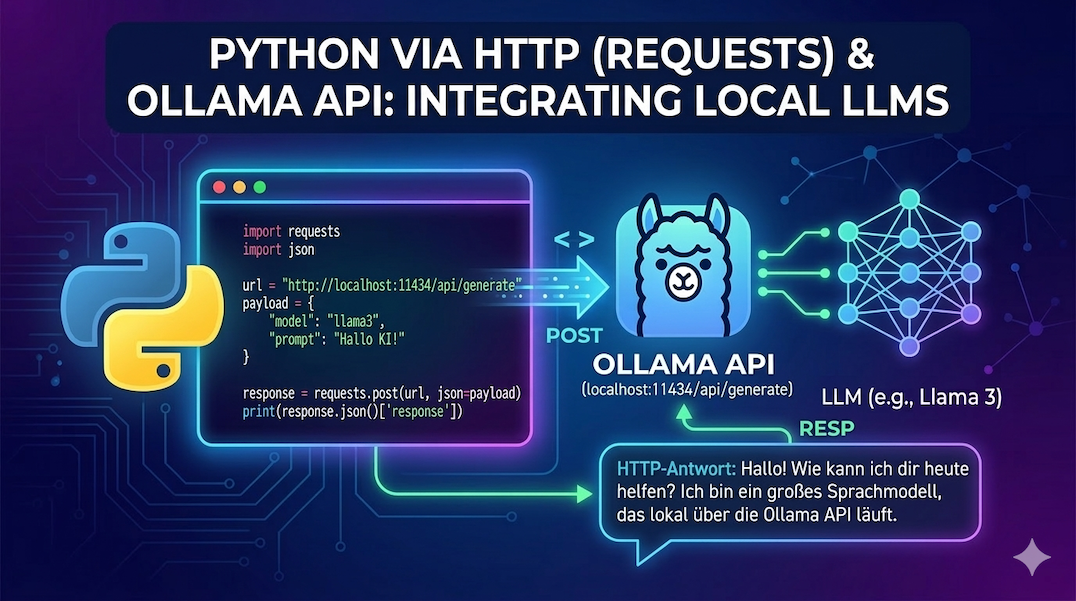

Ollamas API mit Python nutzen

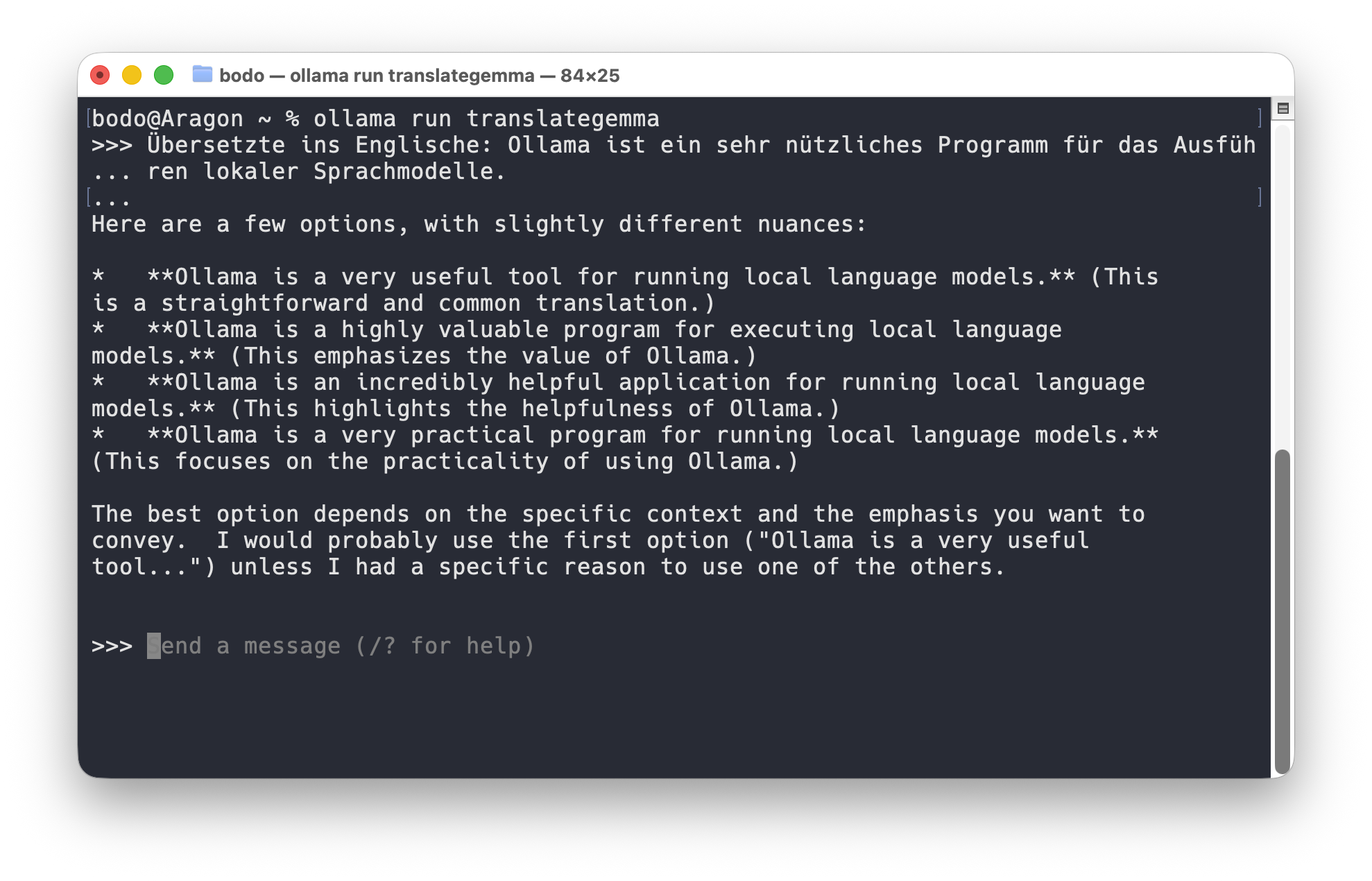

In einem älteren Artikel wurde gezeigt, wie in der Shell mit dem Befehl curl eine Frage an ein vom Ollama verwaltetes Sprachmodell gesendet werden kann. Falls auf dem System als lokale KI das Sprachmodell gemma3 verwendet wird, könnte dies wie folgt aussehen: In diesem Tutorial wird gezeigt, wie dies mit Python umgesetzt werden kann. Dabei wird ebenfalls auf die Ollama-API … Weiterlesen …